Je známe, že Apple záleží vám na dôvernosti údajov, ktoré prechádzajú zariadeniami v ekosystéme, a na tom, že sú veľmi dobre chránené pred zvedavými pohľadmi. To však neznamená, že by sa používatelia nemali riadiť pravidlami etiky, morálky a prečo nie, ľudskosti.

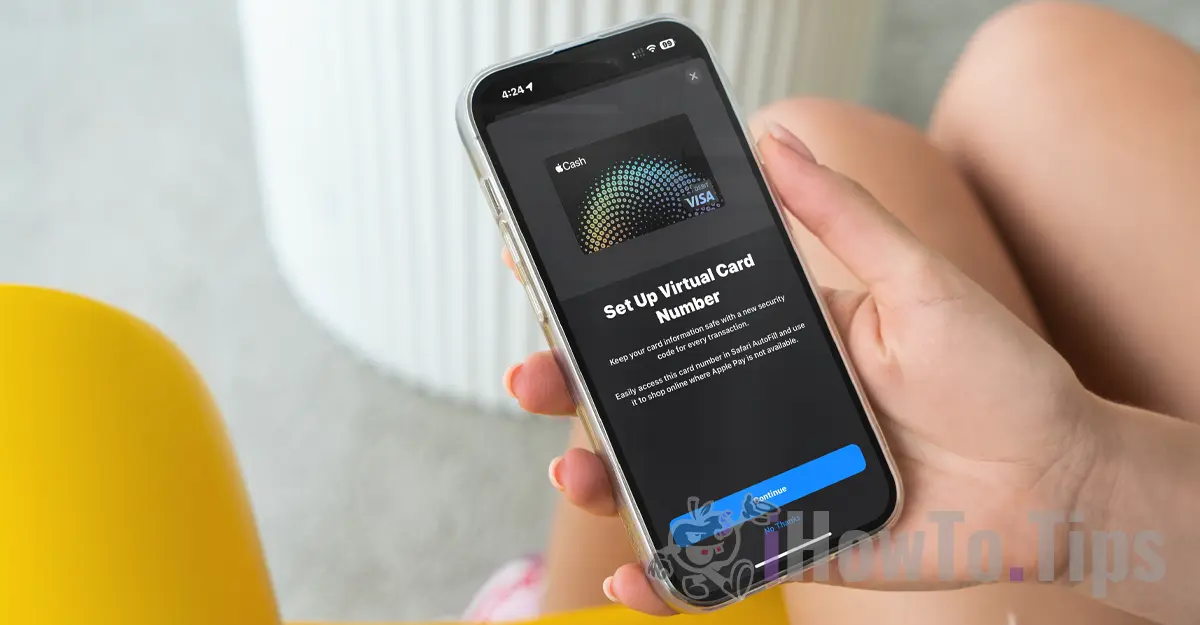

Apple oznámila, že čoskoro uvedie na trh technológiu schopnú skenovať všetky obrázky uložené používateľmi v iCloud a identifikovať fotografie, ktoré obsahujú sexuálne zneužívanie detí. Materiál pre sexuálne zneužívanie detí (CSAM).

Túto technológiu spustí spoločnosť Apple ku koncu tohto roka, pravdepodobne v pilotnej verzii, pre malý počet používateľov.

Ak sa pýtate, „kde je dôvernosť údajov?“, Zistite, že všetko, čo dostávame, je obsah video / fotka prebieha to prostredníctvom šifrovaného protokolu. Rovnako ako ukladanie údajov v iCloud je šifrovaný, ale poskytovatelia takýchto služieb majú kľúč na šifrovanie údajov. Tu hovoríme nielen o Apple. Microsoft, Google a ďalšie služby na ukladanie údajov v cloud ja robím to isté.

Uložené údaje je možné dešifrovať a overiť, ak sú o to požiadané právnym krokom alebo ak flagrantne porušujú zákony. Napríklad tie, ktoré sa týkajú násilných činov voči deťom a ženám.

Aby boli používatelia v bezpečí, spoločnosť sa spolieha na novú technológiu s názvom NeuralHash, ktorá bude skenovať fotografie z iCloud a identifikuje tie, ktoré obsahujú násilie voči deťom, ich porovnaním s inými obrázkami v databáze.

Je to niečo podobné ako rozpoznávanie tváre alebo inteligentné rozpoznávanie predmetov, zvierat a iných prvkov.

Táto technológia bude schopná skenovať a overovať obrázky nasnímané alebo prenesené prostredníctvom zariadenia iPhone, iPad alebo Mac, aj keď prejdú zmenami.